Autovalori e autovettori

Moderatori: ![]() PietroBaima,

PietroBaima, ![]() Ianero

Ianero

1

voti

Mi pare chiaro  DarwinNEche tu debba scrivere un articolo!

DarwinNEche tu debba scrivere un articolo!  E ho idea che sarà molto interessante, date le premesse. Coraggio!

E ho idea che sarà molto interessante, date le premesse. Coraggio!

"Ogni cosa va resa il più possibile semplice, ma non ANCORA più semplice" (A. Einstein)

-

clavicordo

clavicordo

20,7k 6 11 12 - G.Master EY

- Messaggi: 1238

- Iscritto il: 4 mar 2011, 14:10

- Località: Siena

0

voti

Adesso prendiamo un filtro (elettrico, acustico): un filtro è un dispositivo che effettua una trasformazione lineare di un segnale. Chi sono gli autovettori? E gli autovalori?

Poiché nessuno ha risposto, vorresti gentilmente farlo tu, o

Grazie

"Ogni cosa va resa il più possibile semplice, ma non ANCORA più semplice" (A. Einstein)

-

clavicordo

clavicordo

20,7k 6 11 12 - G.Master EY

- Messaggi: 1238

- Iscritto il: 4 mar 2011, 14:10

- Località: Siena

12

voti

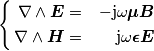

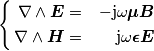

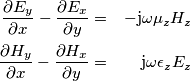

Veniamo al secondo punto del nostro ragionamento. Riprendiamo le equazioni che descrivono il rotore dei campi elettrico e magnetico:

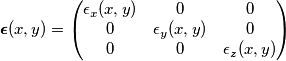

All'interno di esse abbiamo la rappresentazione della struttura all'interno della quale il campo si propaga. Essa è data dalla distribuzione spaziale dei tensori ed

ed  , i quali, come abbiamo detto sopra, dipendono unicamente dallo spazio, ma non dal tempo (problema autonomo o tempo invariante) e neppure dai campi (problema lineare).

, i quali, come abbiamo detto sopra, dipendono unicamente dallo spazio, ma non dal tempo (problema autonomo o tempo invariante) e neppure dai campi (problema lineare).

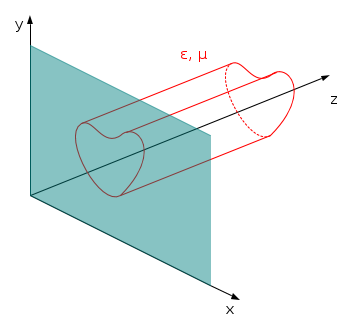

Consideriamo una struttura come la seguente, nella quale esiste una direzione privilegiata (lungo la quale in maniera arbitraria dirigeremo l'asse z):

In altre parole, nel nostro problema, la struttura è invariante secondo l'asse z che sarà il nostro asse di propagazione: ed

ed  .

.

Questo è quello che accade in una guida d'onda come in una fibra ottica in cui la luce è confinata in una direzione e si propaga lungo l'asse della fibra.

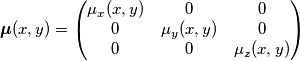

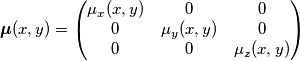

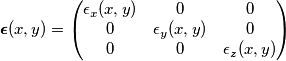

Oltre a questo, supporremo che i tensori di permittività e di permeabilità siano abbastanza semplici da poter esser scritti come una matrice diagonale:

Per scrivere l'operatore differenziale di propagazione dobbiamo fare due cose:

Quanto segue è noioso, ma abbastanza facile. Riscrivendo le due equazioni (vettoriali) del rotore in componenti, si ottengono le sei equazioni qui di seguito:

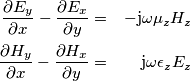

Ora prendiamo queste due equazioni che fanno parte del sistema precedente:

ed utilizziamole per descrivere le componenti longitudinali del campo utilizzando unicamente le componenti trasverse:

utilizzando unicamente le componenti trasverse:

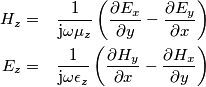

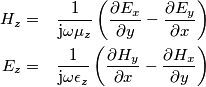

Ora reiniettiamo nel sistemone di cui sopra, e spostiamo a primo membro tutte le derivate rispetto all'asse di propagazione z:

nel sistemone di cui sopra, e spostiamo a primo membro tutte le derivate rispetto all'asse di propagazione z:

![\left \{ \begin{aligned}

\frac{\partial E_x}{\partial z} &=& -\mathrm{j}\omega\mu_y H_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\epsilon_z}\left ( \frac{\partial H_y}{\partial x}-\frac{\partial H_x}{\partial y}\right ) \right ] \\

\frac{\partial E_y}{\partial z} &=& \mathrm{j}\omega\mu_x H_x+\frac{\partial}{\partial y}\left [ \frac{1}{\mathrm{j}\omega\epsilon_z}\left ( \frac{\partial H_y}{\partial x}-\frac{\partial H_x}{\partial y}\right ) \right ] \\

%

\end{aligned}

\right . \left \{ \begin{aligned}

\frac{\partial E_x}{\partial z} &=& -\mathrm{j}\omega\mu_y H_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\epsilon_z}\left ( \frac{\partial H_y}{\partial x}-\frac{\partial H_x}{\partial y}\right ) \right ] \\

\frac{\partial E_y}{\partial z} &=& \mathrm{j}\omega\mu_x H_x+\frac{\partial}{\partial y}\left [ \frac{1}{\mathrm{j}\omega\epsilon_z}\left ( \frac{\partial H_y}{\partial x}-\frac{\partial H_x}{\partial y}\right ) \right ] \\

%

\end{aligned}

\right .](/forum/latexrender/pictures/580e165600f0f0dc52f1249df2e56432.png)

![\left \{ \begin{aligned}

\frac{\partial H_x}{\partial z} &=& \mathrm{j}\omega\epsilon_y E_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ] \\

\frac{\partial H_y}{\partial z} &=& -\mathrm{j}\omega\epsilon_x E_x+\frac{\partial}{\partial y}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ]

\end{aligned}

\right . \left \{ \begin{aligned}

\frac{\partial H_x}{\partial z} &=& \mathrm{j}\omega\epsilon_y E_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ] \\

\frac{\partial H_y}{\partial z} &=& -\mathrm{j}\omega\epsilon_x E_x+\frac{\partial}{\partial y}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ]

\end{aligned}

\right .](/forum/latexrender/pictures/9f74a08c8ed4f5361d2295ddeb31ad70.png)

L'ultimo sistema di equazioni a cui siamo arrivati merita qualche considerazione. Prima di tutto, lo si può interpretare formalmente come un operatore il quale agisce sulle componenti trasverse del campo elettromagnetico e descrive come il campo viene modificato quando la propagazione lungo l'asse z avviene per un tratto infinitesimo dz. In altri termini, in maniera formale, possiamo riscrivere quanto sopra nella maniera seguente:

dove è l'operatore in questione che racchiude in sé da un lato le leggi fisiche (ovvero le equazioni di Maxwell), e dall'altro la struttura nella quale il campo si propaga attraverso la conoscenza della distribuzione di

è l'operatore in questione che racchiude in sé da un lato le leggi fisiche (ovvero le equazioni di Maxwell), e dall'altro la struttura nella quale il campo si propaga attraverso la conoscenza della distribuzione di  e di

e di  .

.

Noteremo en passant che la scelta di avere la struttura invariante rispetto ad una traslazione sull'asse z ci ha guidato nella strategia con cui abbiamo scritto l'operatore, ma l'operatore resta in tutto e per tutto generale. Non abbiamo ancora sfruttato questa proprietà. Ora è il momento di farlo, ponendoci le domande seguenti:

La prima domanda è legata alla ricerca dei modi di propagazione della struttura. La seconda domanda è legata alla possibilità di descrivere ogni distribuzione possibile dei campi come una combinazione di modi di propagazione. In altri termini, è consentito utilizzare una base modale per lo spazio vettoriale rappresentato dal campo elettromagnetico?

Siamo giunti a scrivere un operatore ed intravvediamo il da farsi, ma non abbiamo ancora visto come manipolarlo in modo da otterere oggetti memorizzabili in un calcolatore (matrici, vettori). Intuitivamente, incominciamo a veder apparire cose che ci fanno pensare a autovalori ed autovettori di matrici, ma l'operatore non è una matrice, l'oggetto su cui opera non è un vettore e ci manca ancora un bel po' di strada prima di riuscire a rappresentarli in questa maniera.

non è una matrice, l'oggetto su cui opera non è un vettore e ci manca ancora un bel po' di strada prima di riuscire a rappresentarli in questa maniera.

Mi avete seguito fino a qui?

All'interno di esse abbiamo la rappresentazione della struttura all'interno della quale il campo si propaga. Essa è data dalla distribuzione spaziale dei tensori

ed

ed  , i quali, come abbiamo detto sopra, dipendono unicamente dallo spazio, ma non dal tempo (problema autonomo o tempo invariante) e neppure dai campi (problema lineare).

, i quali, come abbiamo detto sopra, dipendono unicamente dallo spazio, ma non dal tempo (problema autonomo o tempo invariante) e neppure dai campi (problema lineare).Consideriamo una struttura come la seguente, nella quale esiste una direzione privilegiata (lungo la quale in maniera arbitraria dirigeremo l'asse z):

In altre parole, nel nostro problema, la struttura è invariante secondo l'asse z che sarà il nostro asse di propagazione:

ed

ed  .

.Questo è quello che accade in una guida d'onda come in una fibra ottica in cui la luce è confinata in una direzione e si propaga lungo l'asse della fibra.

Oltre a questo, supporremo che i tensori di permittività e di permeabilità siano abbastanza semplici da poter esser scritti come una matrice diagonale:

Per scrivere l'operatore differenziale di propagazione dobbiamo fare due cose:

- scrivere le equazioni di Maxwell unicamente utilizzando le componenti trasverse alla direzione di propagazione (quindi unicamente in termini di

- riarrangiare i termini di modo da far comparire a primo membro tutte le derivate rispetto all'asse di propagazione z

Quanto segue è noioso, ma abbastanza facile. Riscrivendo le due equazioni (vettoriali) del rotore in componenti, si ottengono le sei equazioni qui di seguito:

Ora prendiamo queste due equazioni che fanno parte del sistema precedente:

ed utilizziamole per descrivere le componenti longitudinali del campo

utilizzando unicamente le componenti trasverse:

utilizzando unicamente le componenti trasverse:

Ora reiniettiamo

nel sistemone di cui sopra, e spostiamo a primo membro tutte le derivate rispetto all'asse di propagazione z:

nel sistemone di cui sopra, e spostiamo a primo membro tutte le derivate rispetto all'asse di propagazione z:![\left \{ \begin{aligned}

\frac{\partial E_x}{\partial z} &=& -\mathrm{j}\omega\mu_y H_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\epsilon_z}\left ( \frac{\partial H_y}{\partial x}-\frac{\partial H_x}{\partial y}\right ) \right ] \\

\frac{\partial E_y}{\partial z} &=& \mathrm{j}\omega\mu_x H_x+\frac{\partial}{\partial y}\left [ \frac{1}{\mathrm{j}\omega\epsilon_z}\left ( \frac{\partial H_y}{\partial x}-\frac{\partial H_x}{\partial y}\right ) \right ] \\

%

\end{aligned}

\right . \left \{ \begin{aligned}

\frac{\partial E_x}{\partial z} &=& -\mathrm{j}\omega\mu_y H_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\epsilon_z}\left ( \frac{\partial H_y}{\partial x}-\frac{\partial H_x}{\partial y}\right ) \right ] \\

\frac{\partial E_y}{\partial z} &=& \mathrm{j}\omega\mu_x H_x+\frac{\partial}{\partial y}\left [ \frac{1}{\mathrm{j}\omega\epsilon_z}\left ( \frac{\partial H_y}{\partial x}-\frac{\partial H_x}{\partial y}\right ) \right ] \\

%

\end{aligned}

\right .](/forum/latexrender/pictures/580e165600f0f0dc52f1249df2e56432.png)

![\left \{ \begin{aligned}

\frac{\partial H_x}{\partial z} &=& \mathrm{j}\omega\epsilon_y E_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ] \\

\frac{\partial H_y}{\partial z} &=& -\mathrm{j}\omega\epsilon_x E_x+\frac{\partial}{\partial y}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ]

\end{aligned}

\right . \left \{ \begin{aligned}

\frac{\partial H_x}{\partial z} &=& \mathrm{j}\omega\epsilon_y E_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ] \\

\frac{\partial H_y}{\partial z} &=& -\mathrm{j}\omega\epsilon_x E_x+\frac{\partial}{\partial y}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ]

\end{aligned}

\right .](/forum/latexrender/pictures/9f74a08c8ed4f5361d2295ddeb31ad70.png)

L'ultimo sistema di equazioni a cui siamo arrivati merita qualche considerazione. Prima di tutto, lo si può interpretare formalmente come un operatore il quale agisce sulle componenti trasverse del campo elettromagnetico e descrive come il campo viene modificato quando la propagazione lungo l'asse z avviene per un tratto infinitesimo dz. In altri termini, in maniera formale, possiamo riscrivere quanto sopra nella maniera seguente:

dove

è l'operatore in questione che racchiude in sé da un lato le leggi fisiche (ovvero le equazioni di Maxwell), e dall'altro la struttura nella quale il campo si propaga attraverso la conoscenza della distribuzione di

è l'operatore in questione che racchiude in sé da un lato le leggi fisiche (ovvero le equazioni di Maxwell), e dall'altro la struttura nella quale il campo si propaga attraverso la conoscenza della distribuzione di  e di

e di  .

.Noteremo en passant che la scelta di avere la struttura invariante rispetto ad una traslazione sull'asse z ci ha guidato nella strategia con cui abbiamo scritto l'operatore, ma l'operatore resta in tutto e per tutto generale. Non abbiamo ancora sfruttato questa proprietà. Ora è il momento di farlo, ponendoci le domande seguenti:

- Se

e di

e di  non dipendono da z, esistono delle configurazioni particolari del campo elettromagnetico che conservano qualcosa di simile a questa proprietà?

non dipendono da z, esistono delle configurazioni particolari del campo elettromagnetico che conservano qualcosa di simile a questa proprietà? - E' possibile rappresentare ogni configurazione di campo elettromagnetico come una combinazione lineare di queste?

La prima domanda è legata alla ricerca dei modi di propagazione della struttura. La seconda domanda è legata alla possibilità di descrivere ogni distribuzione possibile dei campi come una combinazione di modi di propagazione. In altri termini, è consentito utilizzare una base modale per lo spazio vettoriale rappresentato dal campo elettromagnetico?

Siamo giunti a scrivere un operatore ed intravvediamo il da farsi, ma non abbiamo ancora visto come manipolarlo in modo da otterere oggetti memorizzabili in un calcolatore (matrici, vettori). Intuitivamente, incominciamo a veder apparire cose che ci fanno pensare a autovalori ed autovettori di matrici, ma l'operatore

non è una matrice, l'oggetto su cui opera non è un vettore e ci manca ancora un bel po' di strada prima di riuscire a rappresentarli in questa maniera.

non è una matrice, l'oggetto su cui opera non è un vettore e ci manca ancora un bel po' di strada prima di riuscire a rappresentarli in questa maniera.Mi avete seguito fino a qui?

Follow me on Mastodon: @davbucci@mastodon.sdf.org

-

DarwinNE

DarwinNE

31,0k 7 11 13 - G.Master EY

- Messaggi: 4420

- Iscritto il: 18 apr 2010, 9:32

- Località: Grenoble - France

11

voti

clavicordo ha scritto:Adesso prendiamo un filtro (elettrico, acustico): un filtro è un dispositivo che effettua una trasformazione lineare di un segnale. Chi sono gli autovettori? E gli autovalori?

Poiché nessuno ha risposto, vorresti gentilmente farlo tu, oDirtyDeeds? penso che la risposta, oltre a me, interesserebbe anche molti altri electroyouini (electroyouani? filoelectroyou? electroyouardi?)!

Speravo rispondesse qualche giovane elettronico/elettrotecnico rampante

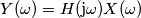

Tutti i segnali esponenziali complessi del tipo

, con

, con  , sono autovettori (o autofunzioni) della trasformazione operata da un filtro (un particolare tipo di operatore detto operatore di convoluzione); gli autovalori sono i valori della funzione di trasferimento calcolata in

, sono autovettori (o autofunzioni) della trasformazione operata da un filtro (un particolare tipo di operatore detto operatore di convoluzione); gli autovalori sono i valori della funzione di trasferimento calcolata in  (tipicamente denotata con

(tipicamente denotata con  ). Tra gli autovettori ci sono in particolare i segnali sinusoidali del tipo

). Tra gli autovettori ci sono in particolare i segnali sinusoidali del tipo  a cui corrispondono gli autovalori

a cui corrispondono gli autovalori  .

.La cosa interessante è che queste autofunzioni, come richiesto in [36], formano una base dello spazio dei segnali: ogni segnale può essere rappresentato come combinazione lineare (la trasformata di Fourier) di segnali sinusoidali complessi: le componenti di un generico "vettore" (segnale)

sono date dalla funzione

sono date dalla funzione  , la trasformata di Fourier di

, la trasformata di Fourier di  (le componenti invece di essere etichettate con degli indici discreti

(le componenti invece di essere etichettate con degli indici discreti  , sono etichettate con un indice continuo). Se all'ingresso di un filtro con funzione di trasferimento

, sono etichettate con un indice continuo). Se all'ingresso di un filtro con funzione di trasferimento  applichiamo un segnale di componenti

applichiamo un segnale di componenti  all'uscita otteniamo un segnale di componenti

all'uscita otteniamo un segnale di componenti

Tale relazione è analoga a quella che avevo scritto alla fine di [36] per le componenti

.

. PS: in quanto detto sopra, c'è un problema di carattere matematico: in [35] ho detto che con la semplice struttura di spazio vettoriale non si può parlare di somme infinite di vettori, perché manca la nozione di convergenza. La trasformata di Fourier (ma anche la serie) è invece una somma infinita: per poter descrivere queste somme infinite è allora necessario che lo spazio dei segnali di un filtro non sia solo equipaggiato della struttura di spazio vettoriale, ma anche di una struttura topologica. Ma queste cose le lasciamo ai matematici

Un articolo collegato al discorso precedente è questo.

It's a sin to write  instead of

instead of  (Anonimo).

(Anonimo).

...'cos you know that ain't

ain't  , right?

, right?

You won't get a sexy tan if you write in lieu of

in lieu of  .

.

Take a log for a fireplace, but don't take for

for  arithm.

arithm.

instead of

instead of  (Anonimo).

(Anonimo)....'cos you know that

ain't

ain't  , right?

, right?You won't get a sexy tan if you write

in lieu of

in lieu of  .

.Take a log for a fireplace, but don't take

for

for  arithm.

arithm.-

DirtyDeeds

DirtyDeeds

55,9k 7 11 13 - G.Master EY

- Messaggi: 7012

- Iscritto il: 13 apr 2010, 16:13

- Località: Somewhere in nowhere

9

voti

Adesso trattiamo il primo problema veramente delicato del metodo RCWA/AFMM. Abbiamo terminato il messaggio [43] fornendo un operatore differenziale, ma nella forma attuale non sappiamo ancora come manipolarlo.

Quello che ci piacerebbe fare per ottenere uno strumento di calcolo abbastanza generale sarebbe infilarlo dentro un computer per far di conto su strutture realistiche.

Una prima cosa che ci può venire in mente di fare è di trasformare le derivate spaziali contenute nell'operatore in operazioni algebriche, utilizzando la trasformata di Fourier.

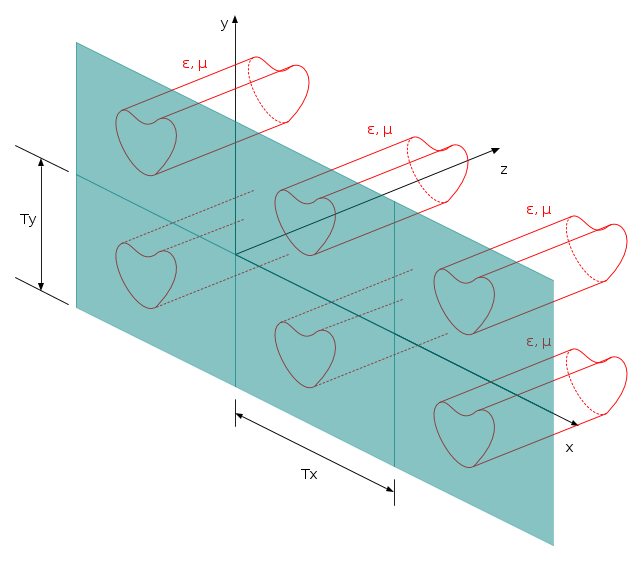

In realtà, per far stare il tutto nella memoria finita di un calcolatore, più che la trasformata di Fourier (che ci fornisce una funzione continua), possiamo utilizzare la serie di Fourier, generando una periodicità artificiale replicando la struttura da considerare. Pertanto, in realtà si considera una struttura simile a quella visibile in figura qui sotto.

Si noterà che abbiamo introdotto le grandezze e

e  che sono il periodo scelto in x ed in y da adottare per la periodizzazione artificiale. Il periodo va scelto con attenzione e vedremo come in seguito.

che sono il periodo scelto in x ed in y da adottare per la periodizzazione artificiale. Il periodo va scelto con attenzione e vedremo come in seguito.

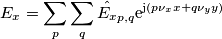

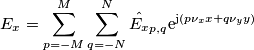

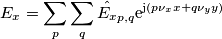

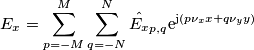

A questo punto, possiamo rappresentare ogni cosa variabile nello spazio (quindi i campi, le permeabilità e le permettività) utilizzando serie di Fourier:

dove le somme vanno da a

a  e le frequenze spaziali sono definite a partire dai periodi visti sopra:

e le frequenze spaziali sono definite a partire dai periodi visti sopra:

ed in maniera analoga

ed in maniera analoga

Ovviamente il problema di fare stare la rappresentazione del campo nella memoria (finita) di un calcolatore non è ancora risolto, perché abbiamo un insieme discreto, certo, ma pur sempre un numero infinito di armoniche .

.

La soluzione pratica è ovviamente quella di tenere un numero finito di armoniche lungo l'asse x e

lungo l'asse x e  lungo l'asse y:

lungo l'asse y:

Dopodiché, si potranno impaccare tutte le armoniche una dopo l'altra in un vettore colonna procedendo per blocchi: si inizia da e

e  e si incrementa

e si incrementa  fino ad arrivare a

fino ad arrivare a  . Dopodiché si incrementa

. Dopodiché si incrementa  e si ripete il ciclo fino a che non sono stati messi in colonna tutti gli

e si ripete il ciclo fino a che non sono stati messi in colonna tutti gli  elementi.

elementi.

Chiameremo questo vettore![[E_x] [E_x]](/forum/latexrender/pictures/d3ac4e46ce88e5b3641e685e4c116efb.png) dove le parentesi quadre indicano appunto quest'operazione di prendere la serie di Fourier troncata ed impaccare in colonna le armoniche nella maniera descritta.

dove le parentesi quadre indicano appunto quest'operazione di prendere la serie di Fourier troncata ed impaccare in colonna le armoniche nella maniera descritta.

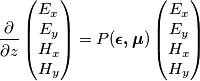

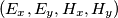

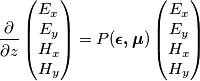

Mettendo uno sopra l'altro i vettori corrispondenti alle componenti transverse, si riescono a manipolare tutti i campi in un vettore colonna unico:

![\begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix} \begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix}](/forum/latexrender/pictures/cda7ecf99fd307d5edbb7b31c2667c42.png)

Abbiamo visto come rappresentare i campi con un vettore colonna. Se si riesce a vedere come si trasforma in una matrice l'operatore differenziale nello spazio di Fourier, a parte un dettaglio (la derivata rispetto a z), ci troviamo con un problema classico agli autovalori:

l'operatore differenziale nello spazio di Fourier, a parte un dettaglio (la derivata rispetto a z), ci troviamo con un problema classico agli autovalori:

![\frac{\partial}{\partial z}\begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix}=

A\begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix} \frac{\partial}{\partial z}\begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix}=

A\begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix}](/forum/latexrender/pictures/310398ff0e0013802646c9748143999b.png)

Naturalmente abbiamo glissato su una marea di problemi pratici e matematici che si pongono nei passaggi effettuati: come esser sicuri che la struttura periodicizzata che otteniamo sia sempre rappresentativa della struttura di partenza? Come scegliere il numero di armoniche e

e  da tenere in memoria? Come fare in modo che la convergenza delle serie di Fourier sia soddisfacente in tutti i casi di importanza pratica?

da tenere in memoria? Come fare in modo che la convergenza delle serie di Fourier sia soddisfacente in tutti i casi di importanza pratica?

Come vedremo, queste domande non sono affatto banali.

Quello che ci piacerebbe fare per ottenere uno strumento di calcolo abbastanza generale sarebbe infilarlo dentro un computer per far di conto su strutture realistiche.

Una prima cosa che ci può venire in mente di fare è di trasformare le derivate spaziali contenute nell'operatore in operazioni algebriche, utilizzando la trasformata di Fourier.

In realtà, per far stare il tutto nella memoria finita di un calcolatore, più che la trasformata di Fourier (che ci fornisce una funzione continua), possiamo utilizzare la serie di Fourier, generando una periodicità artificiale replicando la struttura da considerare. Pertanto, in realtà si considera una struttura simile a quella visibile in figura qui sotto.

Si noterà che abbiamo introdotto le grandezze

e

e  che sono il periodo scelto in x ed in y da adottare per la periodizzazione artificiale. Il periodo va scelto con attenzione e vedremo come in seguito.

che sono il periodo scelto in x ed in y da adottare per la periodizzazione artificiale. Il periodo va scelto con attenzione e vedremo come in seguito.A questo punto, possiamo rappresentare ogni cosa variabile nello spazio (quindi i campi, le permeabilità e le permettività) utilizzando serie di Fourier:

dove le somme vanno da

a

a  e le frequenze spaziali sono definite a partire dai periodi visti sopra:

e le frequenze spaziali sono definite a partire dai periodi visti sopra: ed in maniera analoga

ed in maniera analoga

Ovviamente il problema di fare stare la rappresentazione del campo nella memoria (finita) di un calcolatore non è ancora risolto, perché abbiamo un insieme discreto, certo, ma pur sempre un numero infinito di armoniche

.

.La soluzione pratica è ovviamente quella di tenere un numero finito di armoniche

lungo l'asse x e

lungo l'asse x e  lungo l'asse y:

lungo l'asse y:

Dopodiché, si potranno impaccare tutte le armoniche una dopo l'altra in un vettore colonna procedendo per blocchi: si inizia da

e

e  e si incrementa

e si incrementa  fino ad arrivare a

fino ad arrivare a  . Dopodiché si incrementa

. Dopodiché si incrementa  e si ripete il ciclo fino a che non sono stati messi in colonna tutti gli

e si ripete il ciclo fino a che non sono stati messi in colonna tutti gli  elementi.

elementi.Chiameremo questo vettore

![[E_x] [E_x]](/forum/latexrender/pictures/d3ac4e46ce88e5b3641e685e4c116efb.png) dove le parentesi quadre indicano appunto quest'operazione di prendere la serie di Fourier troncata ed impaccare in colonna le armoniche nella maniera descritta.

dove le parentesi quadre indicano appunto quest'operazione di prendere la serie di Fourier troncata ed impaccare in colonna le armoniche nella maniera descritta.Mettendo uno sopra l'altro i vettori corrispondenti alle componenti transverse, si riescono a manipolare tutti i campi in un vettore colonna unico:

![\begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix} \begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix}](/forum/latexrender/pictures/cda7ecf99fd307d5edbb7b31c2667c42.png)

Abbiamo visto come rappresentare i campi con un vettore colonna. Se si riesce a vedere come si trasforma in una matrice

l'operatore differenziale nello spazio di Fourier, a parte un dettaglio (la derivata rispetto a z), ci troviamo con un problema classico agli autovalori:

l'operatore differenziale nello spazio di Fourier, a parte un dettaglio (la derivata rispetto a z), ci troviamo con un problema classico agli autovalori:![\frac{\partial}{\partial z}\begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix}=

A\begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix} \frac{\partial}{\partial z}\begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix}=

A\begin{pmatrix}

[E_x]\\

[E_y]\\

[H_x]\\

[H_y]

\end{pmatrix}](/forum/latexrender/pictures/310398ff0e0013802646c9748143999b.png)

Naturalmente abbiamo glissato su una marea di problemi pratici e matematici che si pongono nei passaggi effettuati: come esser sicuri che la struttura periodicizzata che otteniamo sia sempre rappresentativa della struttura di partenza? Come scegliere il numero di armoniche

e

e  da tenere in memoria? Come fare in modo che la convergenza delle serie di Fourier sia soddisfacente in tutti i casi di importanza pratica?

da tenere in memoria? Come fare in modo che la convergenza delle serie di Fourier sia soddisfacente in tutti i casi di importanza pratica?Come vedremo, queste domande non sono affatto banali.

Follow me on Mastodon: @davbucci@mastodon.sdf.org

-

DarwinNE

DarwinNE

31,0k 7 11 13 - G.Master EY

- Messaggi: 4420

- Iscritto il: 18 apr 2010, 9:32

- Località: Grenoble - France

9

voti

Non ho dimenticato la promessa, non temete

Adesso la questione diventa abbastanza tosta. Prendiamo una delle equazioni dell'operatore differenziale di propagazione definito nel messaggio [43] e riscriviamola qui. Il nostro obiettivo sarà di trascrivere tutti i termini tramite operazioni matriciali.

![\frac{\partial H_x}{\partial z} = \mathrm{j}\omega\epsilon_y E_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ] \frac{\partial H_x}{\partial z} = \mathrm{j}\omega\epsilon_y E_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ]](/forum/latexrender/pictures/3ef006c385a28a0098d555f5e107db33.png)

Ci sono alcune difficoltà:

1. Scrivere un prodotto di due termini che variano nello spazio come un prodotto di matrice per vettore. Mi interesso quindi a quello che avviene al termine , dove

, dove  è un vettore colonna ottenuto con la procedura vista sopra.

è un vettore colonna ottenuto con la procedura vista sopra.

2. Riuscire a scrivere l'operatore derivata ( oppure

oppure  ) come una matrice che, nello spazio di Fourier, calcola la derivata del vettore colonna alla quale viene moltiplicata.

) come una matrice che, nello spazio di Fourier, calcola la derivata del vettore colonna alla quale viene moltiplicata.

Una volta che saremo in grado di scrivere tutti i termini, non ci saranno più problemi e potremmo sfruttare la linearità della trasformata di Fourier per scrivere l'equazione completa (che è lineare).

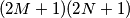

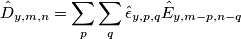

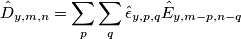

Problema 1: moltiplicazione di termini variabili nello spazio

Trattando il primo problema, ci ricordiamo di un teorema molto comodo che ci dice che il prodotto semplice diventa una convoluzione quando si prendono le serie o le trasformate di Fourier. Nel nostro caso, se prendiamo , se conosciamo le armoniche di

, se conosciamo le armoniche di  e di

e di  , non abbiamo che da scrivere la versione discreta di una convoluzione per ottenere le armoniche di

, non abbiamo che da scrivere la versione discreta di una convoluzione per ottenere le armoniche di  , il nostro risultato:

, il nostro risultato:

Un problema su cui non ci soffermeremo (ma che nelle implementazioni pratiche è importante) è che quando si tronca la serie di Fourier ad un certo numero di armoniche, per ottenere armoniche in x ed

armoniche in x ed  armoniche in y per la rappresentazione di

armoniche in y per la rappresentazione di  , abbiamo bisogno di

, abbiamo bisogno di  armoniche in x ed

armoniche in x ed  armoniche in y sia per

armoniche in y sia per  che per

che per  .

.

Nel messaggio [45] abbiamo visto come piazzare le armoniche dei campi (e quindi di ) in colonna. Una strategia che permette di rappresentare le convoluzioni discrete tramite un prodotto di una matrice per un vettore colonna è suggerito dalla possibilità di dare alla matrice (che conterrà le armoniche di

) in colonna. Una strategia che permette di rappresentare le convoluzioni discrete tramite un prodotto di una matrice per un vettore colonna è suggerito dalla possibilità di dare alla matrice (che conterrà le armoniche di  ) una struttura particolare, chiamata matrice di Toeplitz a blocchi.

) una struttura particolare, chiamata matrice di Toeplitz a blocchi.

Non entro qui nei dettagli, maggiori informazioni sulle matrici di Toeplitz si trovano facilmente in rete e nei testi specializzati.

http://it.wikipedia.org/wiki/Matrice_di_Toeplitz

http://www.ecsutton.ece.ufl.edu/dip/han ... pt05p3.pdf

Curiosamente, sembra che i fisici che lavorano sulla RCWA utilizzano per ragioni storiche un approccio un poco diverso da quello che ho seguito io ed adottano una terminologia un po' differente. Quando ho studiato il metodo, io ci ho messo un po' per capire che la moltiplicazione di una matrice di Toeplitz per un vettore colonna era nient'altro che la convoluzione. Ho trovato utile fare un po' di bibliografia sul trattamento delle immagini.

La procedura descritta si chiama "regola diretta", oppure "regola di Laurent":

![[D_y]=[[\epsilon_y]] [E_y] [D_y]=[[\epsilon_y]] [E_y]](/forum/latexrender/pictures/f66cbe76dfd6453b21e65b37e156df85.png)

dove le parentesi quadre indicano un vettore colonna, con le armoniche "srotolate", mentre le parentesi doppie indicano una matrice di Toeplitz a blocchi, costruita a partire dalle armoniche del termine in esso contenuto.

Qui si intravvede uno dei grandi problemi della RCWA. Capita spesso, infatti, che le strutture studiate siano rappresentate da distribuzioni di che contengono delle discontinuità. Ora, una serie di Fourier non converge uniformemente ad una funzione discontinua. Succedono ogni genere di catastrofi, come i fenomeni di Gibbs e robe del genere.

che contengono delle discontinuità. Ora, una serie di Fourier non converge uniformemente ad una funzione discontinua. Succedono ogni genere di catastrofi, come i fenomeni di Gibbs e robe del genere.

Ora, capita di avere certi casi (polarizzazione TE) in cui è discontinuo, ma

è discontinuo, ma  è continuo e qui la procedura vista sopra va bene. In altri (polarizzazione TM)

è continuo e qui la procedura vista sopra va bene. In altri (polarizzazione TM)  è discontinuo, e

è discontinuo, e  è pure discontinuo. Catastrofe assicurata.

è pure discontinuo. Catastrofe assicurata.

Ora, uno dei colpi di genio di due studiosi (citerò in fondo tutti i vari articoli, comunque sono Lifeng Li e Philippe Lalanne) è stato il rendersi conto quasi contemporaneamente nel 1996 che se e

e  sono entrambi discontinui, il loro prodotto per essere soluzione dell'equazioni di Maxwell deve essere continuo. Si tratta quindi di trovare una regola alternativa

sono entrambi discontinui, il loro prodotto per essere soluzione dell'equazioni di Maxwell deve essere continuo. Si tratta quindi di trovare una regola alternativa

Ecco la "regola inversa", oppure "regola di Li":

![[D_y]=[[1/\epsilon_y]]^{-1} [E_y] [D_y]=[[1/\epsilon_y]]^{-1} [E_y]](/forum/latexrender/pictures/2bbeeeee89841d3afa43a4eca5a6006d.png)

Ovvero, si prende , si calcolano le armoniche, si costruisce con esse la matrice di Toeplitz a blocchi e poi si prende l'inversa e la si moltiplica per il vettore colonna

, si calcolano le armoniche, si costruisce con esse la matrice di Toeplitz a blocchi e poi si prende l'inversa e la si moltiplica per il vettore colonna ![[E_y] [E_y]](/forum/latexrender/pictures/39c0bb5691eeecb0979ea30047283a47.png) .

.

Molto inchiostro è stato usato per inquadrare bene il problema e per fornire una soluzione adatta a descrivere il problema in un modo sufficientemente generale per poter trattare i due casi in un modo unificato in 3D. Qui ci basterà citare l'articolo di Schuster et al. che per primo ha fornito una soluzione elegante e compatta:

http://www.opticsinfobase.org/josaa/abs ... ?id=140936

In pratica, si richiede all'utente di specificare un "campo normale" (normal field), ovvero un campo vettoriale in cui i vettori indicano in ogni punto la direzione normale rispetto alle discontinuità della permettività. In questo modo, il metodo permette di combinare la regola di Laurent e la regola di Li di modo da poter in ogni punto fattorizzare il campo nel migliore dei modi nello spazio di Fourier.

Questo è stato un problema difficile, la prossima volta vedremo come ci si comporta con le derivate.

Adesso la questione diventa abbastanza tosta. Prendiamo una delle equazioni dell'operatore differenziale di propagazione definito nel messaggio [43] e riscriviamola qui. Il nostro obiettivo sarà di trascrivere tutti i termini tramite operazioni matriciali.

![\frac{\partial H_x}{\partial z} = \mathrm{j}\omega\epsilon_y E_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ] \frac{\partial H_x}{\partial z} = \mathrm{j}\omega\epsilon_y E_y+\frac{\partial}{\partial x}\left [ \frac{1}{\mathrm{j}\omega\mu_z}\left ( \frac{\partial E_x}{\partial y}-\frac{\partial E_y}{\partial x}\right ) \right ]](/forum/latexrender/pictures/3ef006c385a28a0098d555f5e107db33.png)

Ci sono alcune difficoltà:

1. Scrivere un prodotto di due termini che variano nello spazio come un prodotto di matrice per vettore. Mi interesso quindi a quello che avviene al termine

, dove

, dove  è un vettore colonna ottenuto con la procedura vista sopra.

è un vettore colonna ottenuto con la procedura vista sopra.2. Riuscire a scrivere l'operatore derivata (

oppure

oppure  ) come una matrice che, nello spazio di Fourier, calcola la derivata del vettore colonna alla quale viene moltiplicata.

) come una matrice che, nello spazio di Fourier, calcola la derivata del vettore colonna alla quale viene moltiplicata.Una volta che saremo in grado di scrivere tutti i termini, non ci saranno più problemi e potremmo sfruttare la linearità della trasformata di Fourier per scrivere l'equazione completa (che è lineare).

Problema 1: moltiplicazione di termini variabili nello spazio

Trattando il primo problema, ci ricordiamo di un teorema molto comodo che ci dice che il prodotto semplice diventa una convoluzione quando si prendono le serie o le trasformate di Fourier. Nel nostro caso, se prendiamo

, se conosciamo le armoniche di

, se conosciamo le armoniche di  e di

e di  , non abbiamo che da scrivere la versione discreta di una convoluzione per ottenere le armoniche di

, non abbiamo che da scrivere la versione discreta di una convoluzione per ottenere le armoniche di  , il nostro risultato:

, il nostro risultato:

Un problema su cui non ci soffermeremo (ma che nelle implementazioni pratiche è importante) è che quando si tronca la serie di Fourier ad un certo numero di armoniche, per ottenere

armoniche in x ed

armoniche in x ed  armoniche in y per la rappresentazione di

armoniche in y per la rappresentazione di  , abbiamo bisogno di

, abbiamo bisogno di  armoniche in x ed

armoniche in x ed  armoniche in y sia per

armoniche in y sia per  che per

che per  .

.Nel messaggio [45] abbiamo visto come piazzare le armoniche dei campi (e quindi di

) in colonna. Una strategia che permette di rappresentare le convoluzioni discrete tramite un prodotto di una matrice per un vettore colonna è suggerito dalla possibilità di dare alla matrice (che conterrà le armoniche di

) in colonna. Una strategia che permette di rappresentare le convoluzioni discrete tramite un prodotto di una matrice per un vettore colonna è suggerito dalla possibilità di dare alla matrice (che conterrà le armoniche di  ) una struttura particolare, chiamata matrice di Toeplitz a blocchi.

) una struttura particolare, chiamata matrice di Toeplitz a blocchi.Non entro qui nei dettagli, maggiori informazioni sulle matrici di Toeplitz si trovano facilmente in rete e nei testi specializzati.

http://it.wikipedia.org/wiki/Matrice_di_Toeplitz

http://www.ecsutton.ece.ufl.edu/dip/han ... pt05p3.pdf

Curiosamente, sembra che i fisici che lavorano sulla RCWA utilizzano per ragioni storiche un approccio un poco diverso da quello che ho seguito io ed adottano una terminologia un po' differente. Quando ho studiato il metodo, io ci ho messo un po' per capire che la moltiplicazione di una matrice di Toeplitz per un vettore colonna era nient'altro che la convoluzione. Ho trovato utile fare un po' di bibliografia sul trattamento delle immagini.

La procedura descritta si chiama "regola diretta", oppure "regola di Laurent":

![[D_y]=[[\epsilon_y]] [E_y] [D_y]=[[\epsilon_y]] [E_y]](/forum/latexrender/pictures/f66cbe76dfd6453b21e65b37e156df85.png)

dove le parentesi quadre indicano un vettore colonna, con le armoniche "srotolate", mentre le parentesi doppie indicano una matrice di Toeplitz a blocchi, costruita a partire dalle armoniche del termine in esso contenuto.

Qui si intravvede uno dei grandi problemi della RCWA. Capita spesso, infatti, che le strutture studiate siano rappresentate da distribuzioni di

che contengono delle discontinuità. Ora, una serie di Fourier non converge uniformemente ad una funzione discontinua. Succedono ogni genere di catastrofi, come i fenomeni di Gibbs e robe del genere.

che contengono delle discontinuità. Ora, una serie di Fourier non converge uniformemente ad una funzione discontinua. Succedono ogni genere di catastrofi, come i fenomeni di Gibbs e robe del genere.Ora, capita di avere certi casi (polarizzazione TE) in cui

è discontinuo, ma

è discontinuo, ma  è continuo e qui la procedura vista sopra va bene. In altri (polarizzazione TM)

è continuo e qui la procedura vista sopra va bene. In altri (polarizzazione TM)  è discontinuo, e

è discontinuo, e  è pure discontinuo. Catastrofe assicurata.

è pure discontinuo. Catastrofe assicurata. Ora, uno dei colpi di genio di due studiosi (citerò in fondo tutti i vari articoli, comunque sono Lifeng Li e Philippe Lalanne) è stato il rendersi conto quasi contemporaneamente nel 1996 che se

e

e  sono entrambi discontinui, il loro prodotto per essere soluzione dell'equazioni di Maxwell deve essere continuo. Si tratta quindi di trovare una regola alternativa

sono entrambi discontinui, il loro prodotto per essere soluzione dell'equazioni di Maxwell deve essere continuo. Si tratta quindi di trovare una regola alternativa Ecco la "regola inversa", oppure "regola di Li":

![[D_y]=[[1/\epsilon_y]]^{-1} [E_y] [D_y]=[[1/\epsilon_y]]^{-1} [E_y]](/forum/latexrender/pictures/2bbeeeee89841d3afa43a4eca5a6006d.png)

Ovvero, si prende

, si calcolano le armoniche, si costruisce con esse la matrice di Toeplitz a blocchi e poi si prende l'inversa e la si moltiplica per il vettore colonna

, si calcolano le armoniche, si costruisce con esse la matrice di Toeplitz a blocchi e poi si prende l'inversa e la si moltiplica per il vettore colonna ![[E_y] [E_y]](/forum/latexrender/pictures/39c0bb5691eeecb0979ea30047283a47.png) .

.Molto inchiostro è stato usato per inquadrare bene il problema e per fornire una soluzione adatta a descrivere il problema in un modo sufficientemente generale per poter trattare i due casi in un modo unificato in 3D. Qui ci basterà citare l'articolo di Schuster et al. che per primo ha fornito una soluzione elegante e compatta:

http://www.opticsinfobase.org/josaa/abs ... ?id=140936

In pratica, si richiede all'utente di specificare un "campo normale" (normal field), ovvero un campo vettoriale in cui i vettori indicano in ogni punto la direzione normale rispetto alle discontinuità della permettività. In questo modo, il metodo permette di combinare la regola di Laurent e la regola di Li di modo da poter in ogni punto fattorizzare il campo nel migliore dei modi nello spazio di Fourier.

Questo è stato un problema difficile, la prossima volta vedremo come ci si comporta con le derivate.

Follow me on Mastodon: @davbucci@mastodon.sdf.org

-

DarwinNE

DarwinNE

31,0k 7 11 13 - G.Master EY

- Messaggi: 4420

- Iscritto il: 18 apr 2010, 9:32

- Località: Grenoble - France

0

voti

Ciao  DirtyDeeds.

DirtyDeeds.

Tu dici:

La domanda è: gli autovettori sono sempre tra loro ortogonali? Se sì, come si dimostra?

Grazie della tua risposta o grazie ad altri che vorranno rispondermi!

Tu dici:

Supponiamo, inoltre, che gli autovettori costituiscano una base dello spazio degli stati

La domanda è: gli autovettori sono sempre tra loro ortogonali? Se sì, come si dimostra?

Grazie della tua risposta o grazie ad altri che vorranno rispondermi!

"Ogni cosa va resa il più possibile semplice, ma non ANCORA più semplice" (A. Einstein)

-

clavicordo

clavicordo

20,7k 6 11 12 - G.Master EY

- Messaggi: 1238

- Iscritto il: 4 mar 2011, 14:10

- Località: Siena

0

voti

Da quello che ricordo, due autovettori associati ad autovalori diversi sono sempre ortogonali.

Invece, autovettori aventi lo stesso autovalore possono non essere ortogonali.

L'implicazione è che quando ci sono autovettori multipli potrebbe non essere possibile avere una base ortogonale fatta di autovettori. Una base di autovettori potrebbe comunque esistere (avviene se la matrice è diagonalizzabile), solo che questi non sono per forza ortogonali.

Per le dimostrazioni, dovrei guardare i miei libri di algebra, ma non li ho sottomano.

Invece, autovettori aventi lo stesso autovalore possono non essere ortogonali.

L'implicazione è che quando ci sono autovettori multipli potrebbe non essere possibile avere una base ortogonale fatta di autovettori. Una base di autovettori potrebbe comunque esistere (avviene se la matrice è diagonalizzabile), solo che questi non sono per forza ortogonali.

Per le dimostrazioni, dovrei guardare i miei libri di algebra, ma non li ho sottomano.

Follow me on Mastodon: @davbucci@mastodon.sdf.org

-

DarwinNE

DarwinNE

31,0k 7 11 13 - G.Master EY

- Messaggi: 4420

- Iscritto il: 18 apr 2010, 9:32

- Località: Grenoble - France

2

voti

clavicordo ha scritto:La domanda è: gli autovettori sono sempre tra loro ortogonali?

In generale, no, perché autovelori e autovettori possono anche essere definiti per spazi non dotati di prodotto interno.

It's a sin to write  instead of

instead of  (Anonimo).

(Anonimo).

...'cos you know that ain't

ain't  , right?

, right?

You won't get a sexy tan if you write in lieu of

in lieu of  .

.

Take a log for a fireplace, but don't take for

for  arithm.

arithm.

instead of

instead of  (Anonimo).

(Anonimo)....'cos you know that

ain't

ain't  , right?

, right?You won't get a sexy tan if you write

in lieu of

in lieu of  .

.Take a log for a fireplace, but don't take

for

for  arithm.

arithm.-

DirtyDeeds

DirtyDeeds

55,9k 7 11 13 - G.Master EY

- Messaggi: 7012

- Iscritto il: 13 apr 2010, 16:13

- Località: Somewhere in nowhere

0

voti

Io invece mi porrei un'altra domanda..

Come faccio ad essere sicuro che autovettori provenienti ad esempio da 2 autovalori differenti, uno di molteplicità

autovettori provenienti ad esempio da 2 autovalori differenti, uno di molteplicità  e uno di molteplicità

e uno di molteplicità  (tali che

(tali che  ) sono sempre linearmente indipendenti?

) sono sempre linearmente indipendenti?

Oppure detta anche così:

Perché l'unione di basi di autospazi relativi ad autovalori differenti forma un insieme linearmente indipendente sempre?

Come faccio ad essere sicuro che

autovettori provenienti ad esempio da 2 autovalori differenti, uno di molteplicità

autovettori provenienti ad esempio da 2 autovalori differenti, uno di molteplicità  e uno di molteplicità

e uno di molteplicità  (tali che

(tali che  ) sono sempre linearmente indipendenti?

) sono sempre linearmente indipendenti?Oppure detta anche così:

Perché l'unione di basi di autospazi relativi ad autovalori differenti forma un insieme linearmente indipendente sempre?

Chi c’è in linea

Visitano il forum: Nessuno e 3 ospiti

Elettrotecnica e non solo (admin)

Elettrotecnica e non solo (admin) Un gatto tra gli elettroni (IsidoroKZ)

Un gatto tra gli elettroni (IsidoroKZ) Esperienza e simulazioni (g.schgor)

Esperienza e simulazioni (g.schgor) Moleskine di un idraulico (RenzoDF)

Moleskine di un idraulico (RenzoDF) Il Blog di ElectroYou (webmaster)

Il Blog di ElectroYou (webmaster) Idee microcontrollate (TardoFreak)

Idee microcontrollate (TardoFreak) PICcoli grandi PICMicro (Paolino)

PICcoli grandi PICMicro (Paolino) Il blog elettrico di carloc (carloc)

Il blog elettrico di carloc (carloc) DirtEYblooog (dirtydeeds)

DirtEYblooog (dirtydeeds) Di tutto... un po' (jordan20)

Di tutto... un po' (jordan20) AK47 (lillo)

AK47 (lillo) Esperienze elettroniche (marco438)

Esperienze elettroniche (marco438) Telecomunicazioni musicali (clavicordo)

Telecomunicazioni musicali (clavicordo) Automazione ed Elettronica (gustavo)

Automazione ed Elettronica (gustavo) Direttive per la sicurezza (ErnestoCappelletti)

Direttive per la sicurezza (ErnestoCappelletti) EYnfo dall'Alaska (mir)

EYnfo dall'Alaska (mir) Apriamo il quadro! (attilio)

Apriamo il quadro! (attilio) H7-25 (asdf)

H7-25 (asdf) Passione Elettrica (massimob)

Passione Elettrica (massimob) Elettroni a spasso (guidob)

Elettroni a spasso (guidob) Bloguerra (guerra)

Bloguerra (guerra)