jmonty ha scritto:Provo a fare dei calcoli:

Quindi credo che con una telecamere da 20-25 FPS dovrebbe farcela;

Dipende da come è fatto il sistema.

jmonty ha scritto:ora non so come i tempi di latenza (calcoli di: image processing, image analysis etc...) ed i tempi rubati all'esecuzione del programma da parte del SO e degli altri processi presenti sulla macchina possano degradare le prestazioni.

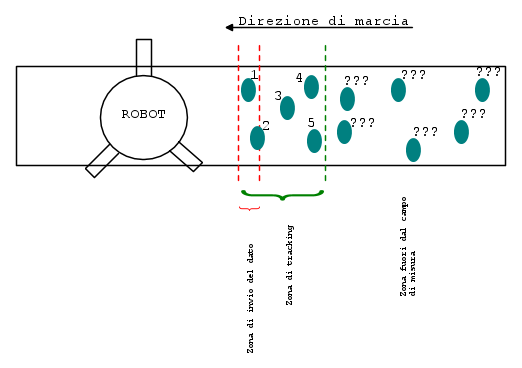

Il problema non è il tempo necessario per calcolare la posizione ma il fatto che durante quel tempo il target si è spostato.

Se il nastro procede a velocità costante ed il delta robot è sincronizzato con il tuo sistema di image processing allora puoi predirre dov'è il pezzo nell'istante di pick.

La condizione necessaria è quindi che i due sistemi abbiano un timer sincronizzato ( la precisione dipende da quanto veloce è il processo ) e che la predizione sia fatta a bordo del robot il quale calcola in tempo reale la posizione predetta in base a quella fornita.

E' altresì importante analizzare il bus di campo utilizzato per trasferire il dato della posizione dal PC al robot.

Essendo l'applicazione dinamica devi impiegare una telecamera con global shutter.

Le Basler sono ottime ( es. acA640-90gm ). Driver e le librerie di gestione della telecamera sono gratuite e molto ben fatte ( non male neanche l'efficienza ).

Ti consiglio ovviamente una telecamera in bianco e nero e preferibilmente GigE. Evita le USB3.0 perché non ti permettono di collocare la telecamera distante dal PC.

Per il PC puoi iniziare con un qualsiasi PC con un i7 a bordo e almeno 16 GB di RAM.

Per le ottimizzazioni CUDA puoi aspettare i risultati delle prove con il processore centrale.

Ti consiglio di iniziare le prove con Windows perché il Visual Studio aiuta molto nello sviluppo. Inoltre si riescono ad avere frame-rate di tutto rispetto ( sono arrivato fino a 100 Hz senza particolari problemi ).

Se poi vuoi fare il porting del software sotto Linux la cosa è abbastanza immediata perché le librerie sono le medesime ed i driver sono disponibili.

Elettrotecnica e non solo (admin)

Elettrotecnica e non solo (admin) Un gatto tra gli elettroni (IsidoroKZ)

Un gatto tra gli elettroni (IsidoroKZ) Esperienza e simulazioni (g.schgor)

Esperienza e simulazioni (g.schgor) Moleskine di un idraulico (RenzoDF)

Moleskine di un idraulico (RenzoDF) Il Blog di ElectroYou (webmaster)

Il Blog di ElectroYou (webmaster) Idee microcontrollate (TardoFreak)

Idee microcontrollate (TardoFreak) PICcoli grandi PICMicro (Paolino)

PICcoli grandi PICMicro (Paolino) Il blog elettrico di carloc (carloc)

Il blog elettrico di carloc (carloc) DirtEYblooog (dirtydeeds)

DirtEYblooog (dirtydeeds) Di tutto... un po' (jordan20)

Di tutto... un po' (jordan20) AK47 (lillo)

AK47 (lillo) Esperienze elettroniche (marco438)

Esperienze elettroniche (marco438) Telecomunicazioni musicali (clavicordo)

Telecomunicazioni musicali (clavicordo) Automazione ed Elettronica (gustavo)

Automazione ed Elettronica (gustavo) Direttive per la sicurezza (ErnestoCappelletti)

Direttive per la sicurezza (ErnestoCappelletti) EYnfo dall'Alaska (mir)

EYnfo dall'Alaska (mir) Apriamo il quadro! (attilio)

Apriamo il quadro! (attilio) H7-25 (asdf)

H7-25 (asdf) Passione Elettrica (massimob)

Passione Elettrica (massimob) Elettroni a spasso (guidob)

Elettroni a spasso (guidob) Bloguerra (guerra)

Bloguerra (guerra)